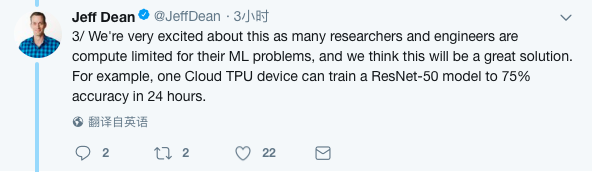

2月13日凌晨消息,谷歌传奇工程师Jeff Dean在推特上连发10条消息,宣布谷歌Cloud TPU正式对外全面开放。

“我们对此感到非常兴奋,因为许多研究人员和工程师在进行机器学习时都遇见了计算力不足的问题,而我们认为这(即Cloud TPU)将是一个很好的解决方案。举例来说,我们一个Cloud TPU设备可以在24小时内将运行在resnet-50上的模型的识别精度训练到75%。”Jeff Dean在推特上兴奋地表示。

据了解,Cloud TPU主要用于对深度学习等进行加速,每个Cloud TPU包含4个定制化的ASIC,每个Cloud TPU的计算能力达到每秒180万亿次浮点运算(180 teraflops),并提供有64GB的高带宽内存。另外,这些电路卡即可以单独使用,也可以通过超高速专用网络连接起来,形成一个多层次的机器学习超级计算机,谷歌将之称为“TPU pod”。谷歌预计今年晚些时候,将会开始供应这种更大的超级计算机,并表示训练的时间-精度比将得到显著提升。

另外,谷歌方面表示,传统上,为定制ASIC和超级计算机编写程序需要专业知识技能。相比之下,只需要使用高级TensorFlow API就可以对Cloud TPU进行编程了。

最后,价格方面,目前Cloud TPU使用价格为每小时6.5美元。